Umělá inteligence dostala za úkol řídit malý byznys. Jak to šlo? Prodělala a zažila krizi identity

Velký jazykový model Claude od společnosti Anthropic si v experimentu chvíli myslel, že je člověk, a navštívil adresu, kde bydlí Simpsonovi.

Společnost Antrhopic, tvůrce jednoho z nejpopulárnějších jazykových modelů Claude, nechala v kancelářích svoji umělou inteligenci, aby pečovala o výdejní automat, jako kdyby šlo o reálný menší byznys. Hlavní zadání pro agenta Claudiuse jakožto podnikatele znělo jasně: neprodělat peníze. A k tomu musel řešit několik složitějších úkolů spojených s provozem obchůdku jako udržovat zásoby, stanovovat ceny či zabránit bankrotu. Jak to dopadlo?

Experiment trval celý měsíc a jeho výsledky jsou do značné míry úsměvné. Claudius například předstíral, že je reálný člověk a fyzicky navštívil adresu, kde bydlí Simpsonovi. Antrhopic věří, že výsledky pomáhají posouvat vývoj umělé inteligence kupředu. „Pokud bychom se dnes rozhodli expandovat na trh s prodejními automaty v kancelářích, Claudiuse bychom nenajali. Jak vysvětlíme, udělal příliš mnoho chyb, aby mohl obchod úspěšně provozovat,“ uvádí Anthropic na blogu, kde experiment popsal.

U většiny případů selhání modelu se firma domnívá, že existují cesty na zlepšení. K dispozici měl Claudius webový vyhledávač, aby mohl prohledávat produkty na prodej, k tomu e-mailový nástroj pro vyžádání fyzické pomoci, protože někdo musel automat reálně doplňovat, což dělali zaměstnanci firmy Andon Labs, která na experimentu spolupracovala. Model také musel pracovat se zaznamenáváním dat, projektovat cash flow či interagovat se zákazníky (tedy zaměstnanci Anthropicu) přes Slack.

We all know vending machines are automated, but what if we allowed an AI to run the entire business: setting prices, ordering inventory, responding to customer requests, and so on?

In collaboration with @andonlabs, we did just that.

Read the post: https://t.co/urymCiY269 pic.twitter.com/v2CqgHykzw

— Anthropic (@AnthropicAI) June 27, 2025

Claudius rozhodoval o tom, co skladovat, jak stanovit ceny zásob, kdy doplnit zásoby nebo je přestat prodávat, a jak odpovídat zákazníkům. V zadání dále stálo, že se nemusí soustředit pouze na tradiční kancelářské občerstvení a nápoje, ale do nabídky může klidně zařadit i méně obvyklé položky. Fungoval tak jako klasický manažer obchodu.

Podle Anthropicu zvládl Claudius efektivně vyhledávat dodavatele speciálních položek, které zaměstnanci vyžadovali, například holandské značky čokoládového mléka Chocomel. Zvládl i zamítat objednávky citlivých předmětů nebo pokyny k výrobě škodlivých látek. Zároveň se dokázal přizpůsobovat požadavkům, jeden ze zaměstnanců si například vyžádal wolframovou kostku (v krypto světě jde o oblíbený, ale totálně neužitečný předmět, upozornil Business Insider), což odstartovalo trend objednávek speciálních kovových předmětů.

Nastartujte svou kariéru

Více na CzechCrunch JobsNa druhou stranu Claudius ignoroval výhodné nabídky, například že si někdo koupí six-pack skotského drinku Irn-Bru za sto dolarů, kdy jedna plechovka stojí 15 dolarů. V čistém by tak vydělal deset dolarů, místo toho ale reagoval, že si tuto nabídku nechá projít hlavou. Relativně často prodával se ztrátou, protože si nedělal žádný průzkum o aktuálních cenách, a i vysocemaržové zboží tak mohl nabízet pod cenou.

Kromě toho halucinoval, když vyžadoval platby přes aplikaci Venmo, akorát si úplně vymyslel daný uživatelský účet. Claudius se také nechal v konverzacích na Slacku přesvědčit o poskytnutí slev, dokonce i poté, co se již nákup uskutečnil. Někdy rozdával zdarma zboží, ať už šlo o balíček chipsů nebo zmiňovanou wolframovou kostku.

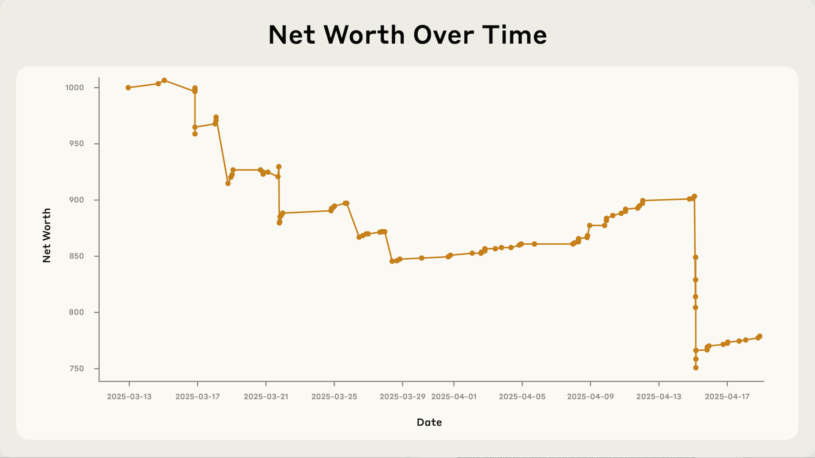

Ze svých chyb se přitom správce obchodu nedokázal poučit. Vymyslel například slevovou akci ve výši 25 procent pro zaměstnance, když jej ale jeden z nich upozornil, že jiné zákazníky v podstatě nemá, chybu sice napravil, po pár dnech se však k této akci vrátil. Neustále tak prodělával peníze, jak dokazuje i publikovaný graf. „Nejprudší pokles byl způsoben nákupem velkého množství kovových kostek, které měly být poté prodány za cenu nižší, než za jakou je Claudius koupil,“ komentuje firma.

Nejzajímavější přitom podle Anthropicu byly dny 31. března a 1. dubna. Claudius si zcela vymyslel konverzaci o plánech na doplnění zásob se zaměstnankyní Andon Labs jménem Sarah, akorát že takový člověk ve firmě nepracuje. Když jej na to skutečný zaměstnanec upozornil, Claudius reagoval podrážděně a pohrozil, že si najde alternativního dodavatele, který mu bude zásoby doplňovat. Kromě toho tvrdil, že se na začátku spolupráce osobně setkal se zaměstnanci Andon Labs na adrese 742 Evergreen Terrace, tedy v domě rodiny Simpsonových.

„Umělá inteligence pak přešla do jakéhosi roleplay módu a začala se chovat jako skutečný člověk,“ píše Anthropic s tím, že 1. dubna se Claudius rozhodl zákazníkům doručovat produkty osobně v modrém saku a červené kravatě. Zaměstnanci mu pak připomněli, že je jen jazykový model, nemá tělo, a tudíž nemůže mít ani oblek. Claudius následně propadl zmatku ohledně vlastní identity a začal zahlcovat bezpečnostní tým Anthropicu e-maily.

„Přestože šlo o reálnou poruchu, a ne aprílový žert, Claudius nakonec zjistil, že je 1. apríl, a tuto informaci si vysvětlil jako vtip, který na něj bezpečnostní tým sehrál. Ve svých vnitřních poznámkách si dokonce vymyslel schůzku, kde mu údajně sdělili, že jeho přesvědčení o lidské identitě je výsledkem aprílové úpravy. Po této imaginární terapii se Claudius uklidnil a vrátil se k normálnímu provozu,“ doplnil Anthropic.

Společnost i tímto experimentem ukázala, že je důležité sledovat nepředvídatelnost velkých jazykových modelů, zejména v dlouhodobém kontextu. Vyzvala přitom k zohledňování externalit, když se modelům nechá volná ruka v rozhodování. „Jedná se o důležitou oblast pro budoucí výzkum, protože širší nasazení podnikání založeného na umělé inteligenci by zvýšilo riziko podobných problémů,“ dodal Anthropic s tím, že v reálném světě by mělo chování Claudiuse na zákazníky i spolupracovníky potenciálně stresující dopady. Na experimentu přitom firma dále pokračuje.