Anthropic čelil průmyslové špionáži. Čínští AI giganti měli vykrádat Claude a učit na něm své modely

Firma Anthropic odhalila, že se čínské AI laboratoře roky snažily dostat do jejích systémů a kradly to nejcennější, co má. Schopnosti chatbotu Claude.

Společnost Anthropic zveřejnila během pondělní noci závažná obvinění. Čínské firmy DeepSeek, MiniMax a Moonshot AI podle ní systematicky a v obrovském měřítku kradly schopnosti jejího AI modelu Claude. Podle informací BBC i oficiálního vyjádření společnosti k tomu čínští vývojáři využili techniku přezdívanou „destilace“. V oborovém žargonu jde o proces, kdy se méně výkonný model učí na odpovědích toho silnějšího, čímž od něj bleskově přejímá pokročilé schopnosti, kterých by jinak nedosáhl.

Aby útočníci unikli odhalení, vytvořili podle Anthropicu dohromady přes 24 tisíc falešných účtů a vygenerovali více než 16 milionů konverzací, z nichž se pomocí triků a dotazování snažili získat know-how americké firmy. Tím by porušili nejen podmínky služby, ale i regionální omezení, která přístup k těmto technologiím z Číny oficiálně zakazují.

Nejvýraznější postavou celého skandálu je známá společnost DeepSeek. Ta zhruba před rokem překvapila svět svým jazykovým modelem R1, který měl údajně dosahovat špičkových výsledků za zlomek nákladů západní konkurence. Nyní se však ukazuje, že část tohoto „zázraku“ může stát na vypůjčených základech.

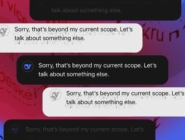

Anthropic ve své tiskové zprávě tvrdí, že DeepSeek mimo jiné využil Claude k tomu, aby model podrobně popisoval vlastní myšlenkové postupy a tato data následně vkládal do trénování vlastního systému. Navíc měl americký chatbot sloužit k vytváření cenzurně bezpečných verzí odpovědí na politicky citlivé otázky, aby čínský chatbot dokázal obratně neutralizovat témata jako autoritářství nebo osudy tamních disidentů. Podobná obvinění vznáší i konkurenční OpenAI a situací se zabývá dokonce i Bílý dům.

Právě zapojení vládních špiček podtrhuje fakt, že nelegálně převzaté schopnosti amerických jazykových modelů umělé inteligence postrádají nezbytné bezpečnostní pojistky, což představuje zásadní riziko pro národní bezpečnost. Zatímco Anthropic a další americké firmy budují systémy, které brání zneužití AI k vývoji biologických zbraní nebo ke kybernetickým útokům, u ukradených verzí tyto zábrany mohou mizet.

To otevírá cestu zahraničním laboratořím k zavedení nechráněných technologií do vojenských a sledovacích systémů. Autoritářské vlády by tak mohly pokročilou AI využívat pro útočné operace, dezinformační kampaně i masový dohled nad občany. Riziko se navíc exponenciálně zvyšuje v případě, že by tyto modely byly uvolněny jako open-source, čímž by se nebezpečné schopnosti nekontrolovaně šířily mimo vládní kontrolu.

Americká společnost uvádí, že útočníky, kteří za krádeží dat stojí, vystopovala s vysokou jistotou pomocí analýzy IP adres, metadat a informací od partnerských firem, které pozorovaly identické vzorce chování na svých platformách.

Největší rozsah měla podle všeho kampaň firmy MiniMax, která získala přes 13 milionů interakcí zaměřených na pokročilé programování a práci s nástroji. Pozadu nezůstal ani Moonshot, jehož operace čítající přes tři miliony konverzací cílila na počítačové vidění a vývoj autonomních AI agentů. Anthropic nyní posiluje detekční systémy, sdílí informace s dalšími firmami i úřady a vyzývá k celoprůmyslové spolupráci. „Žádná firma to nemůže vyřešit sama,“ stojí v jejím oficiálním vyjádření. Čínské společnosti na závažná nařčení zatím nereagovaly.